实验室3篇论文被AAAI 2026接收

发布时间:2025-11-10

近日,我实验3篇论文被第40届人工智能年度大会AAAI 2026录用。AAAI The 40th Annual AAAI Conference on Artificial Intelligence是人工智能方向的顶级学术会议,被中国计算机学会(CCF)评为A类会议。会议将于2026年01月20日至27日在新加坡举行。AAAI 2026共收到23680篇有效投稿,接收4167篇论文,录用率为17.6%。

录用论文的信息如下:

1. PLaST: Towards Paralinguistic-aware Speech Translation

作者:Yi Li+, Rui Zhao+, Ruiquan Zhang, Jinsong Su, Daimeng Wei, Min Zhang, Yidong Chen*

完成单位:厦门大学、华为研究院

论文介绍:

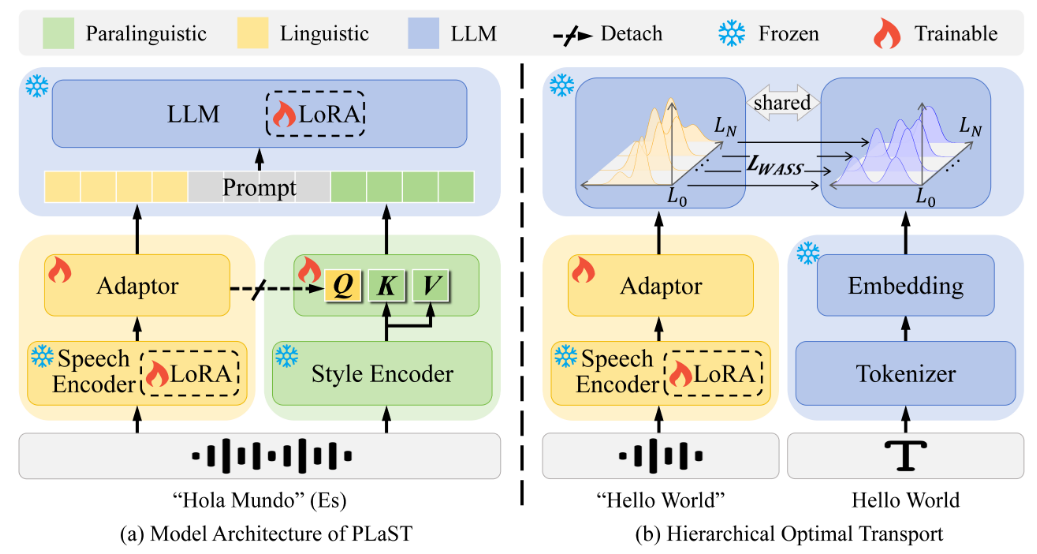

语音翻译(Speech Translation, ST)旨在将源语言语音直接翻译为目标语言文本。然而,语音信号中除语言内容外,还包含语气、情感、强调等副语言线索(paralinguistic cues),这些信息可能显著影响甚至改变语义解读,从而导致不同的翻译结果。现有ST模型普遍缺乏对副语言信息的直接且充分建模,难以全面感知语音中的语用细微差别,限制了翻译性能的进一步提升。为此,本文提出了一种副语言感知的语音翻译框架(ParaLinguistic-aware Speech Translation, PLaST),通过双分支结构显式分离并融合语言与副语言信息。具体而言,PLaST利用语音编码器与风格提取器分别生成语言表征和副语言表征;为进一步获得与文本对齐的纯净语言表征,引入分层最优传输(Hierarchical Optimal Transport)机制对大语言模型解码器的层间输出进行约束;随后,设计基于注意力的检索模块(Attention-based Retrieval, AR),以语言表征为查询,动态检索并精炼副语言信息,实现语义理解与翻译生成的联合引导。在副语言敏感基准ContraProST上的实验表明,PLaST显著优于现有强基线方法;同时在标准语音翻译数据集CoVoST-2上也展现出良好的泛化能力,验证了该方法的有效性与实用性。

2. RFI: Rectified Flow Intervention for Mitigating Object Hallucination in Large Vision-Language Models

作者:Junyu Cheng, Zhibiao Liang, Yidong Chen*, Shuangyin Li*

完成单位:厦门大学,华南师范大学

论文介绍:

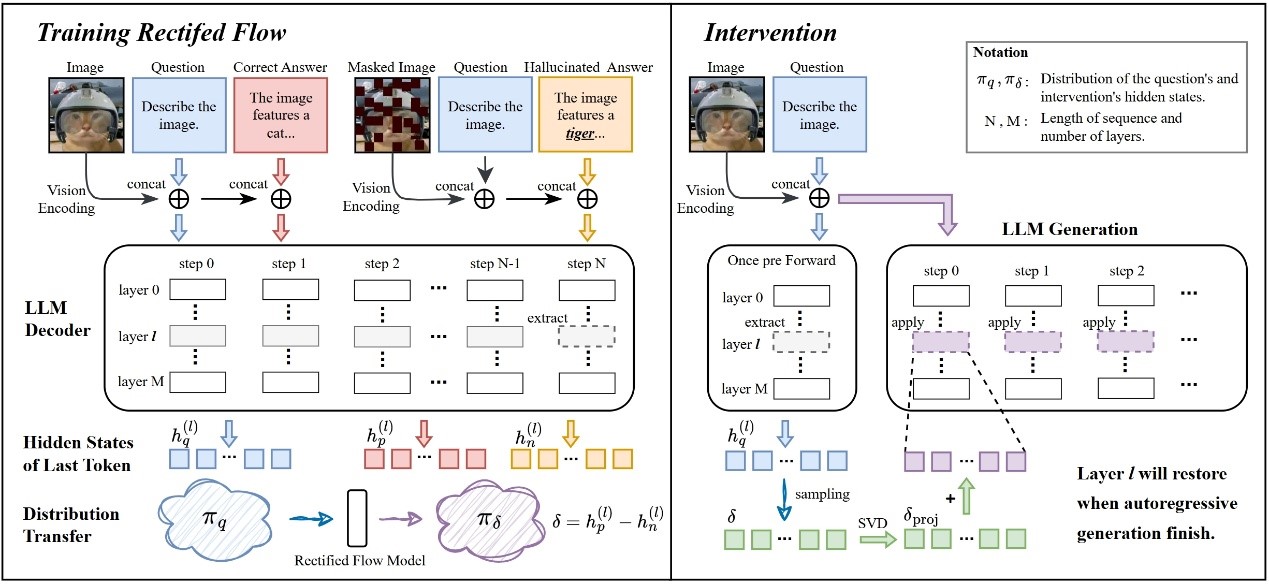

大型视觉语言模型(Large Vision-Language Models, LVLMs)通过融合视觉与文本信息,在多模态理解与生成任务中展现出卓越的能力。然而,这类模型常常出现物体幻觉(object hallucination)问题,即生成的内容与输入图像不一致。现有缓解幻觉的方法主要存在两类局限:一方面,基于 logits 或注意力机制的动态方法容易过度抑制有价值的语言先验;另一方面,采用固定干预向量的静态方法缺乏对不同图像与问题的自适应能力。为了解决上述问题,我们提出了一种新方法——RFI(Rectified Flow Intervention)。RFI 利用校正流(rectified flow)的线性轨迹设计实现输入特定的自适应干预,并通过梯度校正(gradient correction)确保生成过程的一致性,从而有效结合了动态方法的自适应性与静态方法的稳定性。RFI 能够在仅需对每个问题进行一次前向传播的情况下,动态预测潜空间中的干预向量,从而兼顾计算效率(生成100个新 token 的延迟开销仅为1.09倍)。大量实验结果表明,RFI 在显著降低幻觉现象的同时,较现有先进方法取得更优性能,充分展示了其作为一种轻量级、即插即用的 LVLM 幻觉抑制方案在实际应用中的有效性。